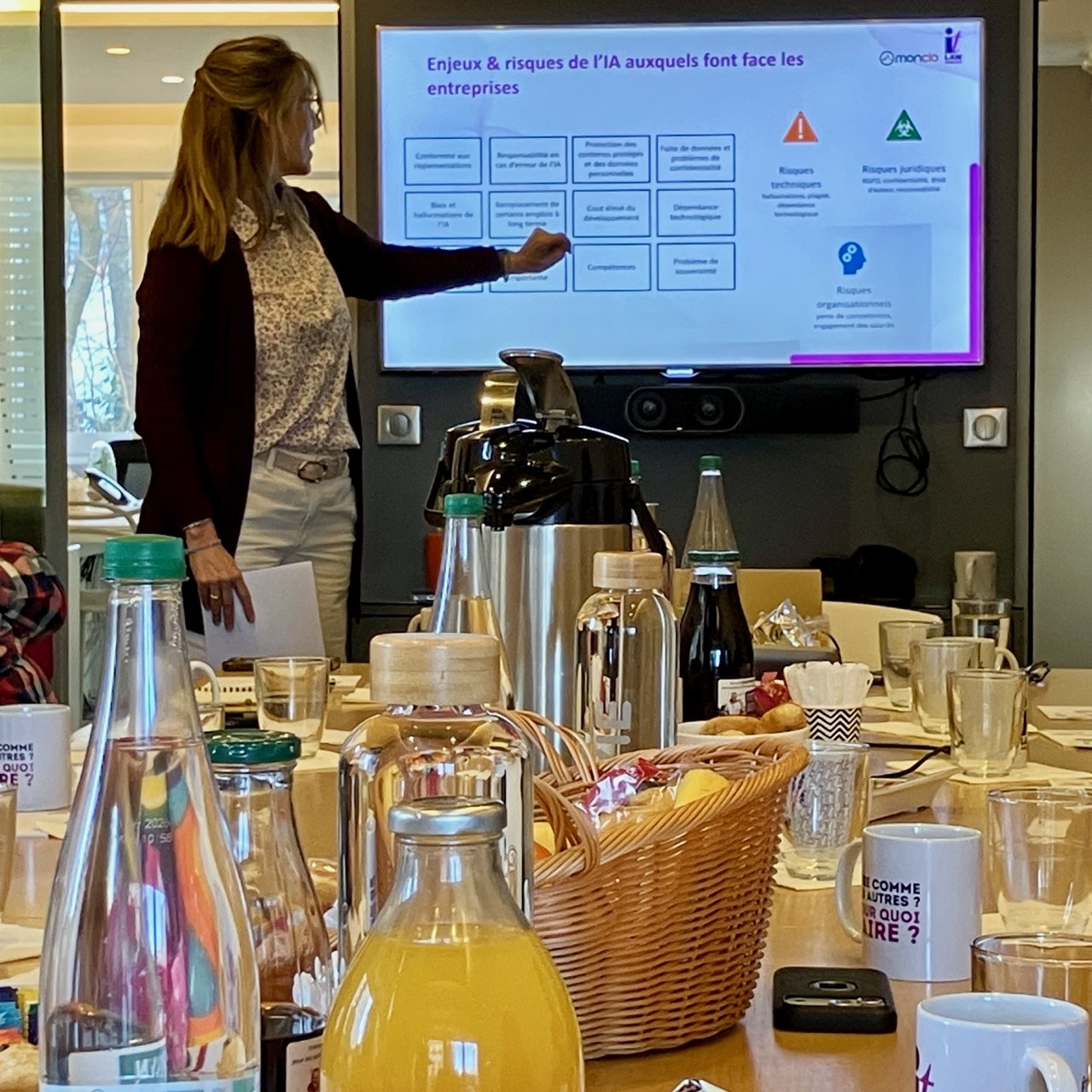

Enjeux des IA génératives, comprendre et maîtriser les risques liés à l’IA générative

7 avril 2025.

L’intelligence artificielle (« IA ») a été l’un des sujets les plus médiatiques en matière IT de ces dernières années. Nous avons observé que l’usage de ces technologies n’est plus réservé aux seuls projets avant-gardistes, l’IA s’immisce dans de nombreux projets informatiques, que l’on en ait conscience ou non.

À ce jour, l’encadrement juridique des usages de solution, d’intelligence artificielle, notamment, dites génératives, reste encore en construction et sera certainement appelé à évoluer dans les prochaines années. Un texte phare en la matière a été adopté récemment par le parlement européen, il s’agit du règlement 2024/1689 eu 13 juin 2024 établissant des règles harmonisées concernant l’intelligence artificielle et modifiant les règlements (CE) n° 300/2008, (UE) n° 167/2013, (UE) n° 168/2013, (UE) 2018/858, (UE) 2018/1139 et (UE) 2019/2144 et les directives 2014/90/UE, (UE) 2016/797 et (UE) 2020/1828 (règlement sur l’intelligence artificielle). Ce règlement propose une approche innovante de gestion par les risques de cette technologie en établissant notamment :

– Des règles harmonisées concernant la mise sur le marché, la mise en service et l’utilisation de systèmes d’IA dans l’Union,

– l’interdiction de certaines pratiques en matière d’IA ;

– des exigences spécifiques applicables aux systèmes d’IA à haut risque et des obligations imposées aux opérateurs de ces systèmes ;

– des règles harmonisées applicables en matière de transparence à certains systèmes d’IA ;

– des règles harmonisées pour la mise sur le marché de modèles d’IA à usage général ;

– des règles relatives au suivi du marché, à la surveillance du marché, à la gouvernance et à l’application des règles ;

– des mesures visant à soutenir l’innovation, en mettant particulièrement l’accent sur les PME, y compris les jeunes pousses.

D’autres textes sont à l’étude au niveau européen visant notamment à créer un cadre juridique concernant la responsabilité extracontractuelle dans le domaine de l’intelligence artificielle. Il est important de retenir que ce cadre légal est à appréhender dans un environnement juridique plus global avec une analyse précise lors de l’élaboration de son projet du cadre légal applicable, comme l’application de textes plus généraux, comme le RGPD ou plus spécifiques dédiés à son secteur d’activité ou à l’usage souhaité de l’IA.

Quelle définition ?

Le règlement 2024/1689 définit un système d’IA comme « un système automatisé qui est conçu pour fonctionner à différents niveaux d’autonomie et peut faire preuve d’une capacité d’adaptation après son déploiement, et qui, pour des objectifs explicites ou implicites, déduit, à partir des entrées qu’il reçoit, la manière de générer des sorties telles que des prédictions, du contenu, des recommandations ou des décisions qui peuvent influencer les environnements physiques ou virtuels« .

Quels risques ?

L’expérience de ces dernières années a fait émerger des risques spécifiques liés à l’usage de ce type de technologie. Sans être exhaustifs, les enjeux suivants doivent être appréhendés dans le cadre d’un projet :

– La fiabilité des résultats générés et les conséquences possibles de leurs usages ;

– la perte de savoir-faire et de compétence ;

– le respect des droits et libertés des personnes ;

– le respect des droits attachés aux données traitées (confidentialité, secret des affaires, etc.).

Ainsi, il apparaît nécessaire, pour chaque projet, de comprendre précisément la solution technique proposée par le prestataire afin d’identifier la présence ou non de l’utilisation d’une technologie d’IA pouvant entraîner des enjeux et risques additionnels par rapport aux risques habituels liés aux technologies. Cela permettra de sécuriser le projet, et donc, l’entreprise.

Quelles pistes pour sécuriser son usage ?

Dans le cadre de la mise en œuvre d’un projet impliquant l’usage d’une IA dite générative, nous vous proposons une liste, bien entendu non exhaustive, chaque projet nécessitant une analyse fine qui lui est propre, ainsi que des questions et points à analyser, à savoir :

– vérifier la conformité légale de l’usage de l’IA (droits fondamentaux, logiciels, base de données, chiffrement, preuve, droit pénal) et des législations dédiées à certains secteurs, tels que la santé, la finance, le droit du travail ;

– définir contractuellement :

o les actions effectuées par l’IA : définir les résultats et fonctionnalités attendus, les actions interdites à l’IA (ex. : suppression de données),

o la répartition des obligations et responsabilités de chaque partie en matière de paramétrage, de sélection et préparation des données alimentant l’IA et de contrôle des résultats ;

– sécuriser la propriété des éléments de chaque partie nécessaires ou générés par l’IA : algorithmes (est-il stable ou évolutif ? À quel moment est-il protégé ?), logiciels, formules mathématiques, base de données, données (initiales, observées, déduites par l’IA, créée par l’IA), œuvre et résultats générés par l’IA : à qui appartient quoi ? Que puis-je utiliser ?

– encadrer contractuellement les imprévus identifiés et notamment anticiper les évolutions de la législation, la charge des coûts engendrés par ces évolutions ;

– évaluer sa responsabilité : anticiper les risques de préqualification de dommages directs et indirects : un biais subi par un utilisateur est-il un dommage direct ? Quels en sont l’origine, le paramétrage, les données, l’utilisation ? Que peut-on intégrer dans le plafond de responsabilité ?

– gérer la conformité à la législation en matière de données à caractère personnel et, notamment, le respect des principes de licéité et loyauté dans la collecte des données, transparence, pertinence et respect du droit des personnes ;

– prévoir la fin du contrat et ses conséquences : est-il possible d’effectuer une réversibilité sans dénaturer la stabilité de l’algorithme de l’IA ? Comment effectuer la transférabilité des données ? Leur anonymisation ? Est-il possible de changer de prestataire ?

En conclusion, à ce jour, les mécanismes contractuels apparaissent comme l’un des points clés de la sécurisation juridique, technique et économique de projets intégrant l’usage d’une intelligence artificielle. Il est donc plus que nécessaire de veiller à leur parfaite adéquation à vos projets innovants !

Marine Hardy, Avocat directeur des pôles Innovation & Sécurité ITLAW Avocats.

Cet article est à retrouver dans le : magazine Décideurs, paroles d’expert Innovation, Technologies & Propriété Intellectuelle 2025